Momento di panico: state guidando e tra due auto parcheggiate sbuca all’improvviso un bambino davanti a voi. È troppo tardi per frenare. Probabilmente chiunque cercherebbe d’istinto di schivare il bambino, anche se questo comporta danni al veicolo.

Oggi è l’automobilista che prende la decisione (inconsciamente)

Per fortuna, situazioni del genere capitano molto di rado. Ancora più di rado accade che il conducente debba decidere chi mettere in pericolo di vita in caso di incidente: immaginatevi di accorgervi troppo tardi di un gruppo di persone intente ad attraversare la strada sulle strisce. La scelta è: o investire il gruppo o girare a destra e andare a sbattere contro il muro, cosa che potrebbe costarvi la vita. In questi casi si decide istintivamente, non esiste «giusto» o «sbagliato».

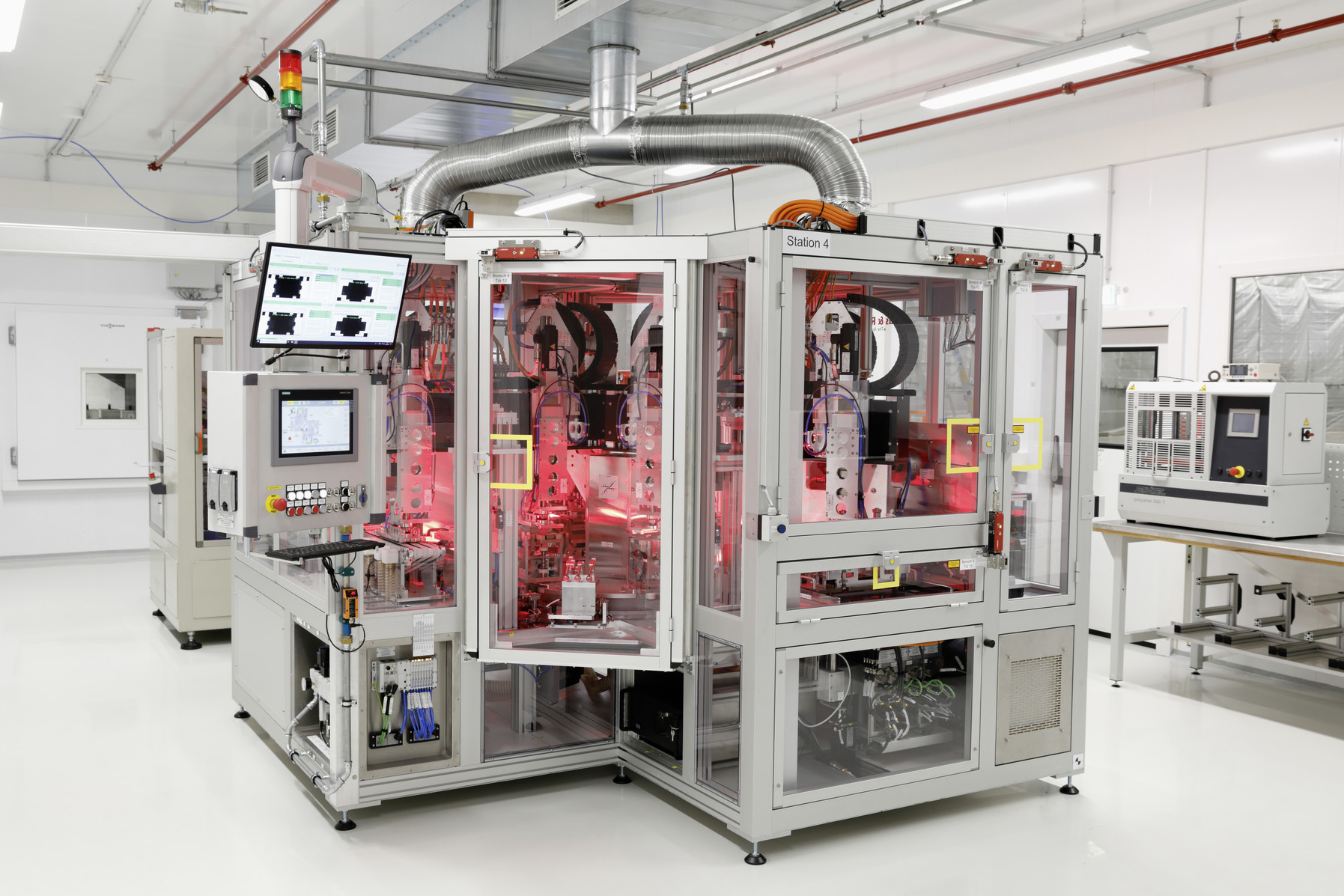

Anche le auto a guida autonoma non sono in grado di evitare del tutto queste situazioni, dal momento che anche loro interagiscono con la gente per strada. Gli incidenti continueranno purtroppo a far parte della mobilità anche quando una volta saliti in un’auto potremo metterci comodi e leggere un libro, guardare un film o lavorare. Tuttavia in quei momenti sarà l’auto, e non voi, a dover prendere la decisione.

Le auto a guida autonoma aumentano il livello di sicurezza

La guida autonoma incrementerà massicciamente il livello di sicurezza sulle strade. Perché le automobili non superano mai i limiti di velocità, non mettono fretta, rispettano le distanze e non guidano in stato di ebbrezza. Nel 2016 sulle strade svizzere si sono verificati 17’500 incidenti con danni a persone. Secondo stime di diversi esperti, dall’80 al 94 percento di questi incidenti si sarebbe potuto evitare. Uno studio della società di consulenza McKinsey parte quindi dal presupposto che con le auto a guida autonoma il numero degli incidenti si ridurrebbe del 90%. E che solo una piccola parte di questi causerebbe danni alle persone.

Serve un «software etico»?

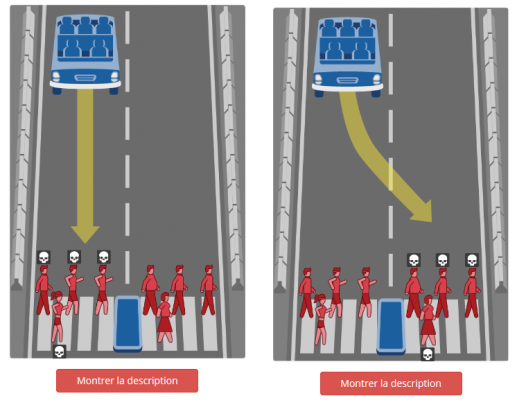

Le auto a guida autonoma sono equipaggiate con un software complesso, che cercherà sempre di evitare danni alle persone. In che modo dovrà decidere l’auto qualora non vi siano vie d’uscita, è un tema su cui stanno discutendo gli studiosi di etica in tutto il mondo. Così, ad esempio, il noto Massachusetts Institute of Technology (MIT) ha creato diversi scenari in cui ciascuno è tenuto a risolvere da sé il dilemma morale: i freni di un’auto a guida autonoma sono in avaria. Chi deve essere salvato? Gli uomini o le donne, i giovani o i vecchi, i medici o i ladri, i passeggeri dell’auto o i pedoni? Sta a voi decidere.

Medico o ladro? Vecchio o giovane? Tu o io?

Questi esperimenti sono giochi mentali molto interessanti, anche se il software difficilmente potrà risolvere il dilemma etico, perché le auto non saranno mai in grado di capire se una persona è un ladro o un medico, se ha 20 anni od 80. Si deve cercare di salvare il maggior numero possibile di persone? Si deve lasciare decidere il destino? Il conducente potrà decidere tra la modalità «salva me» e «salva gli altri», così come oggi può scegliere tra la modalità di guida sportiva e quella ecologica? La soluzione ideale sarebbe quella in grado di ridurre al minimo l’energia della collisione. Tuttavia, anche questa opzione ha vantaggi e svantaggi.

Quale decisione prendete? Proseguite diritti e investite le persone che stanno attraversando la strada col semaforo verde o investite quelle che stanno attraversando col rosso?

Un dilemma al contempo morale e giuridico

Per i costruttori e il legislatore sono questioni difficili da risolvere. Le domande del MIT dimostrano che non tutti seguono gli stessi principi morali. Non è detto che ciò che decide la maggioranza sia giusto, tanto più se la decisione viene presa al computer e non nella realtà. Da ultimo, la nostra costituzione federale vieta di contrapporre tra loro le vite umane. Un «solo» morto non è quindi meglio di cinque morti.

Oltre alle decisioni di ordine morale, c’è anche da chiedersi chi debba assumersi la responsabilità. Già oggi le funzionalità tecniche dell’Audi A8 permettono di affidare la guida alla vettura in caso di incolonnamenti in autostrada. Fra non molto tempo sarebbero anche possibili la guida e il sorpasso autonomi fino a una velocità di 130km/h. Tuttavia la legislazione svizzera sulla guida autonoma non è ancora così avanti. Il conducente continua a essere pienamente responsabile e deve sempre tenere almeno una mano sul volante. Nell’estate del 2017 la Germania ha emanato le prime leggi di base sulla guida autonoma, alle quali ora la legislazione svizzera si sta orientando. Ma come regolamentare la responsabilità in caso di incidente? La risposta è semplice: «Chi guida è responsabile. Il che significa che se l’auto è in marcia in modalità automatica e il conducente non è stato esortato a riprendere il comando, chi risponde è il costruttore. Altrimenti è sempre il conducente», spiega Volker Dohr, avvocato di AMAG Group SA.

Serve un dibattito sociale

Sarà necessario definire le «regole di base» della guida autonoma come società. Questo presuppone però avere ben chiaro come sarà la mobilità di domani: grazie ai veicoli a guida autonoma ci saranno decisamente meno incidenti con feriti o morti. La mobilità è accessibile a tutti. A prescindere se vecchi o giovani, stanchi o riposati, si ha sempre la possibilità di recarsi da A a B. La questione su cosa debba succedere nella più rara delle situazioni estreme non dovrebbe arrestare lo sviluppo positivo.

Per saperne di più sulla guida autonoma.

Attualità e retroscena dall’universo dell’auto. Abbonatevi subito.